Yapay zeka botlarına paylaştığınız gizli bilgiler . Pek çok kişi, yapay zeka sohbet robotlarının sunduğu inanılmaz kolaylıklara kapılıp kişisel verilerini düşünmeden paylaşıyor . Ancak Techneiro analizlerine göre, bu dijital asistanlara emanet ettiğiniz şifreler, özel belgeler. Ve hatta kişisel fotoğraflar, tahmin ettiğinizden çok daha büyük bir gizlilik tehlikesi taşıyor. Bu rehber yazıyı okuduğunuzda yapay zeka sohbet robotlarını güvenle kullanma konusunda tam bilgiye sahip olacaksınız. Peki, bu fütüristik araçlar aslında verilerinizle ne yapıyor ve kendinizi nasıl korumalısınız? İşte tüm detaylar.

Hızlı Özet:

Yapay zeka sohbet robotları varsayılan olarak yüklediğiniz verileri model eğitimi için saklar ve kullanır.

Gizlilik politikası ayarları fark etmeksizin verileriniz 30 güne kadar saklanmaya devam eder. Hatta yasal durumlar için süresiz kalabilir.

Şifreler, tıbbi belgeler ve konum bilgisi içeren fotoğraflar gibi hassas verilerinizi paylaşmak ciddi riskler doğuruyor.

En güvenli yöntem, kişisel veya hassas hiçbir veriyi yapay zeka platformlarına yüklememek.

Veri eğitimini kapatma ve geçici sohbetler kullanma gibi ayarlar var. Ancak yerel yapay zeka modelleri asıl çözümü sunuyor.

Yapay Zeka Sohbet Robotları Verilerinizi Nasıl İşliyor?

Açıkçası, çoğu kullanıcının aklına bile gelmiyor ama ChatGPT, Claude. Ve Gemini gibi popüler yapay zeka araçlarına yüklediğiniz her şey aslında sunuculara gidiyor. Adam Davidson’ın 1 Nisan 2026 tarihli makalesinde aktardığı bilgilere göre, ister bir dokümanı özetlemek isteyin. Ister özçekimlerinizi Studio Ghibli tarzı görsellere dönüştürün, tüm bu işlemler OpenAI’nin sunucularında gerçekleşiyor. İşin aslına bakarsak, OpenAI varsayılan olarak sohbet geçmişlerinizi ve yüklediğiniz dosyaları saklıyor; hatta bunları ChatGPT modellerini geliştirmek için kullanıyor. OpenAI’nin gizlilik politikası da bu durumu açıkça belirtiyor. Bu politika; dosyalar, görseller, ses ve video içerikleri de dahil olmak üzere pek çok veriyi içeriyor.

Kullanıcılar olarak “Modeli herkes için geliştir” seçeneğini devre dışı bırakabilir veya geçici sohbetleri tercih edebiliriz. Ancak dürüst olmak gerekirse, bu adımlar bile bizi tam olarak korumuyor. Çünkü verilerimiz bu durumda bile 30 güne kadar sistemde kalıyor. Dahası, New York Times’ın OpenAI’ye karşı açtığı dava gibi yasal süreçler. 2025 Nisan’ından Eylül’üne kadar yüklediğimiz verilerin süresiz olarak saklanmasına yol açıyor. Bu durum, geçici veya silinen sohbetlerimizin bile yasal bir koz olarak kullanılabileceği anlamına geliyor. Sektör verileri gösteriyor ki, farklı yapay zeka hizmetlerinin gizlilik politikaları değişiklik gösterse de, çoğu varsayılan olarak verileri saklıyor. Ayrıca, önemli bir detay olarak, insan operatörler yüklediğimiz bazı hassas verileri de inceleyebiliyor . Bu durum, bizlere Yapay Zeka Tarayıcıları ve Gözetim Tuzağı makalesinde bahsettiğimiz riskleri bir kez daha hatırlatıyor.

Gizli Veri İhlalleri ve Gözden Kaçan Tehlikeler

Yapay zeka sohbet robotlarına farkında olmadan kişisel verilerimizi aktarma alışkanlığımız, ciddi siber güvenlik risklerini beraberinde getiriyor. Techneiro editör ekibi olarak gözlemlediğimiz kadarıyla, kullanıcılar genellikle belge veya metin kopyalayıp yapıştırırken, içinde yer alan hassas bilgileri gözden kaçırabiliyor. Bir dokümanın tamamını taramadan yüklediğinizde, istemeden şifreleriniz, banka hesap numaralarınız veya özel kimlik bilgileriniz gibi verileri paylaşma ihtimaliniz çok yüksek. Geçmiş tecrübelerimiz, veri ihlallerinin artık hayatımızın bir gerçeği olduğunu bize acı bir şekilde gösteriyor.

Örneğin, teknik bir sorun gidermek amacıyla ekran görüntüleri paylaştığınızda, giriş bilgileriniz veya kritik hesap detaylarınız ortaya çıkabiliyor. Ayrıca, yapay zekadan ikinci bir tıbbi görüş almak için sağlık belgelerinizi yüklediğinizde, bu çok özel bilgiler OpenAI’nin sunucularına gidiyor. OpenAI potansiyel olarak bunları model eğitimi için kullanıyor. İşin ilginç yanı, belgedeki kişisel veriler doğrudan görünmese bile, dosyanın EXIF verileri gibi meta verilerinde gizli bilgiler açığa çıkabiliyor. Bu, özellikle fotoğraflar için büyük bir tehlike oluşturuyor. Bir selfie’yi Studio Ghibli stiline dönüştürmek her ne kadar eğlenceli görünse de, fotoğrafın EXIF verileri GPS konumunuzu bile ele veriyor. Yapay zeka botları bu görselleri, gelecekteki görüntü oluşturma modellerini eğitmek için kullanabiliyor. Bu durum, Grok’un Fotoğraflarınızı Kullanmasını Engelleyin makalemizde de detaylıca ele aldığımız bir güvenlik endişesidir.

Hassas Verilerinizi Yapay Zeka Botlarından Nasıl Korursunuz?

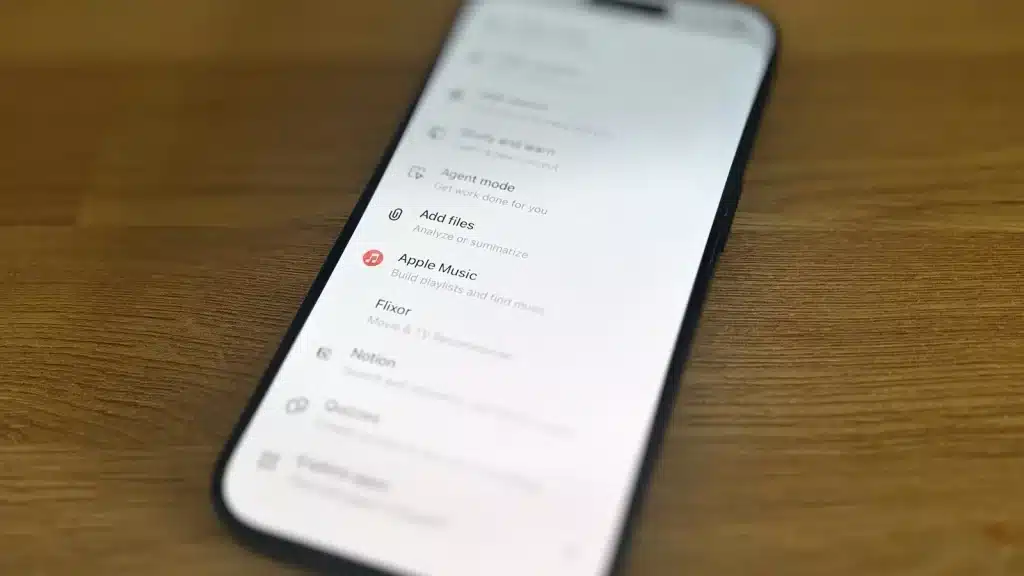

Araştırmalar gösteriyor ki , dijital mahremiyetimizi korumak, özellikle yapay zeka çağında, her zamankinden daha önemli hale geliyor. Neyse ki, yapay zeka sohbet robotlarını kullanırken gizliliğimizi sağlamak için atabileceğimiz bazı somut adımlar var. Öncelikle, veri eğitimini kapatmak kritik bir ilk adım. Web veya masaüstü uygulamasında, profil simgenize tıklayıp “Ayarlar > Veri kontrolleri” yolunu izleyerek “Modeli herkes için geliştir” seçeneğini kapatabiliyorsunuz. Mobil cihazlarda ise “Profil” simgesine dokunup “Veri kontrolleri”ni seçerek aynı işlemi kolayca yapıyorsunuz.

Ancak, daha önce de belirttiğimiz gibi, bu ayar bile verilerinizin 30 gün boyunca saklanmasını engellemiyor. New York Times davasındaki gibi özel durumlarda ise bu durum verilerinizi süresiz olarak kalıcı hale getirebiliyor. Bu yüzden en güvenli yol, kişisel belge veya fotoğraflarınızı yapay zeka platformlarına asla yüklememek. Hassas bilgileri sohbet penceresine yapıştırmaktan kesinlikle kaçınmak gerekiyor. İtiraf etmek gerekirse, bu durum yapay zeka sohbet robotlarının birçok faydalı özelliğini kullanmamızı kısıtladığı için pek çok kullanıcı için gerçekçi değil.

Verilerinizi Güvende Tutmak İçin Alınacak Önlemler

Belge veya görselleri bir yapay zeka platformuna yüklemeniz gerektiğinde, gerçekten zorunlu olup olmadığını düşünmenizi öneriyoruz. Eğer yüklemek kaçınılmazsa, kişisel bilgiler, şifreler, hesap numaraları gibi her türlü hassas veriyi belgeden çıkarmayı unutmayın. Fotoğraflarınızdaki EXIF verilerini temizlemek ve kendinizin veya başkalarının fotoğraflarını mümkün olduğunca yüklememek de büyük önem taşıyor.

Peki, tüm bu özelliklerden faydalanırken gizliliğinizi nasıl koruyacaksınız? İşte size harika bir alternatif: yerel LLM (Büyük Dil Modelleri) kullanmak. Bu modeller, tüm işlemleri kendi bilgisayarınızda yapıyor. Dolayısıyla, hiçbir bilgi üçüncü taraf sunucularına ulaşmıyor. Örneğin, bir belgeyi özetlemeniz gerekiyorsa, yerel bir LLM bu işi nispeten sınırlı donanımlarda bile hallediyor. Ve dokümandaki bilgiler cihazınızdan hiç ayrılmıyor. Özçekimlerinizi Studio Ghibli tarzına dönüştürmek istediğinizde de yerel görüntü oluşturma modellerini kullanabilirsiniz. Bulut tabanlı modeller kadar hızlı olmasalar da, yüzünüzün bir sonraki büyük görüntü oluşturma modelinin eğitimi için kullanılmasından endişelenmenize gerek kalmıyor. Siber Güvenlik kategorimizdeki diğer makaleler de bu tür konularda size rehberlik ediyor.

Yapay Zeka Kullanımında Dikkat Edilmesi Gerekenler Tablosu

| Riskli Bilgi Türü | Olası Sonuçları | Önleme Yöntemleri |

|---|---|---|

| Şifreler ve Giriş Bilgileri | Veri ihlalleri, hesap ele geçirme | Asla doğrudan girmeyin/yüklemeyin. |

| Özel Belgeler (Tıbbi kayıtlar, banka dökümleri) | Model eğitimi, insan incelemesi, sızıntı | Yüklemeden önce hassas verileri temizleyin. |

| Kişisel Fotoğraflar (Selfie’ler, aile fotoğrafları) | Model eğitimi, EXIF verilerinden konum tespiti | Yüklemekten kaçının, EXIF verilerini temizleyin. |

| Şirket Verileri ve Gizli Bilgiler | Fikri mülkiyet hırsızlığı, rekabet avantajı kaybı | Gölge Yapay Zeka Tehlikesi makalesini inceleyin, şirket politikalarına uyun. |

Techneiro’nun Bakış Açısı

Açıkçası, yapay zeka sohbet robotlarının hayatımıza getirdiği kolaylıklar tartışılmaz. Ancak dijital dünyanın bu yeni “mucizeleri” beraberinde göz ardı edemeyeceğimiz devasa bir gizlilik tehdidi getiriyor. Bana sorarsanız, insanlık olarak teknolojiye olan bu kör güvenimiz, çoğu zaman bizi en büyük tehlikelere sürüklüyor. Tıpkı sosyal medyanın ilk yıllarında kişisel bilgileri cömertçe paylaşmamız gibi. Şimdi de yapay zeka botlarına adeta bir dijital günlük tutar gibi her şeyi anlatıyoruz.

Bu, uzun vadede başımızı ağrıtabilecek bir durum. Özellikle New York Times gibi dev bir kuruluşun OpenAI’ye karşı açtığı dava, bu meselenin ne kadar ciddi olduğunu ortaya koyuyor. Bu, sadece bir gizlilik ihlali değil. Aynı zamanda yapay zeka şirketlerinin verilerimizi nasıl yönettiği konusunda daha şeffaf olmaları gerektiğini bize gösteren önemli bir dönüm noktası. Eğer sektör, kullanıcıların kişisel mahremiyetini ciddiye almazsa, yasal düzenleyiciler regülasyonları kaçınılmaz hale getirecek . Ve bu da inovasyonun önünü tıkama riskini taşıyor. Kullanıcılar ise bu süreçte kendi verilerinin sorumluluğunu alarak “Dur, Düşün ve Doğrula” yaklaşımını benimsemelidir.

Sıkça Sorulan Sorular (FAQ)

S: Yapay zeka sohbet robotları verilerimi her durumda saklıyor mu?

*C: Varsayılan olarak çoğu yapay zeka sohbet robotu, model eğitimi amacıyla verilerinizi saklar. “Veri eğitimini kapat” seçeneğini devre dışı bıraksanız bile, botlar verilerinizi yasal gereklilikler veya geçici depolama süreleri nedeniyle 30 güne kadar, hatta daha uzun sürelerde saklayabiliyor.

S: Şifrelerimi veya tıbbi belgelerimi yapay zeka botlarına yüklersen ne olur?

*C: Şifreleriniz, tıbbi belgeleriniz veya diğer hassas bilgileriniz, veri ihlallerine yol açabilir veya model eğitimi süreçlerinde botlar tarafından kullanılarak açığa çıkma riskini taşıyor. Bu tür bilgileri asla doğrudan yapay zeka platformlarına yüklememelisiniz.

S: Yerel LLM kullanmak gizlilik açısından daha mı güvenli?

*C: Evet, yerel LLM’ler (Büyük Dil Modelleri) tüm işlemleri kendi cihazınızda gerçekleştirdiği için verileriniz üçüncü taraf sunucularına ulaşmıyor. Bu, gizliliğinizi korumak için en güvenli yöntemlerden biridir.

Önemli Çıkarımlar:

Yapay zeka sohbet robotları sunduğu kolaylıklarla cazip gelse de, kişisel veri güvenliği konusunda ciddi riskler taşıyor. Şifreler, özel belgeler ve fotoğraflar gibi hassas bilgileri paylaşmaktan kaçınmak, veri eğitimini devre dışı bırakmak ve mümkünse yerel yapay zeka modellerine yönelmek, dijital mahremiyetinizi korumanın anahtarıdır. Piyasa değişmeden önce bu adımları hızlıca atın ve veri güvenliğinizi sağlayın!

Bunları da Okuyun:

- Yapay Zeka Cilginligi Bitmedi Nvidia Paraya Para Demiyor

- Siber Guvenlik

- Google Gemini Uygulamaniz Yavasladi mi Iste Hizlandirmak icin Basit bir Ayar

Kaynak: howtogeek.com